برنامج الـ DeepFake|بعد أزمة بسنت خالد، الطالبة التي قررت التخلص من حياتها والسبب شابين قاما بتزييف صور لها ونشرها عبر مواقع التواصل الإجتماعي، بعد رفض بسنت إقامة علاقة غير شرعية معهما، ويبدو أن بسنت خالد لم تكن هي أول فتاة تتعرض لهذا النوع من الابتزاز الإلكتروني، فبعد إنشاء برنامج الـ DeepFake، بمعني التزييف العميق، الذي يمكنك من خلاله إنشاء محتوي فيديو إباحي لشخص من خلال صورته الشخصية بكل سهولة ويسر.

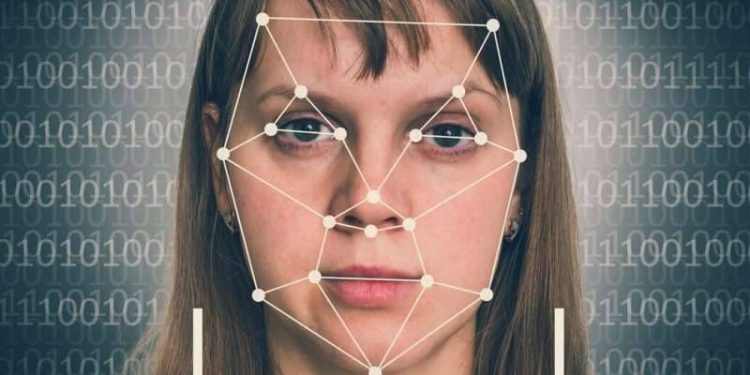

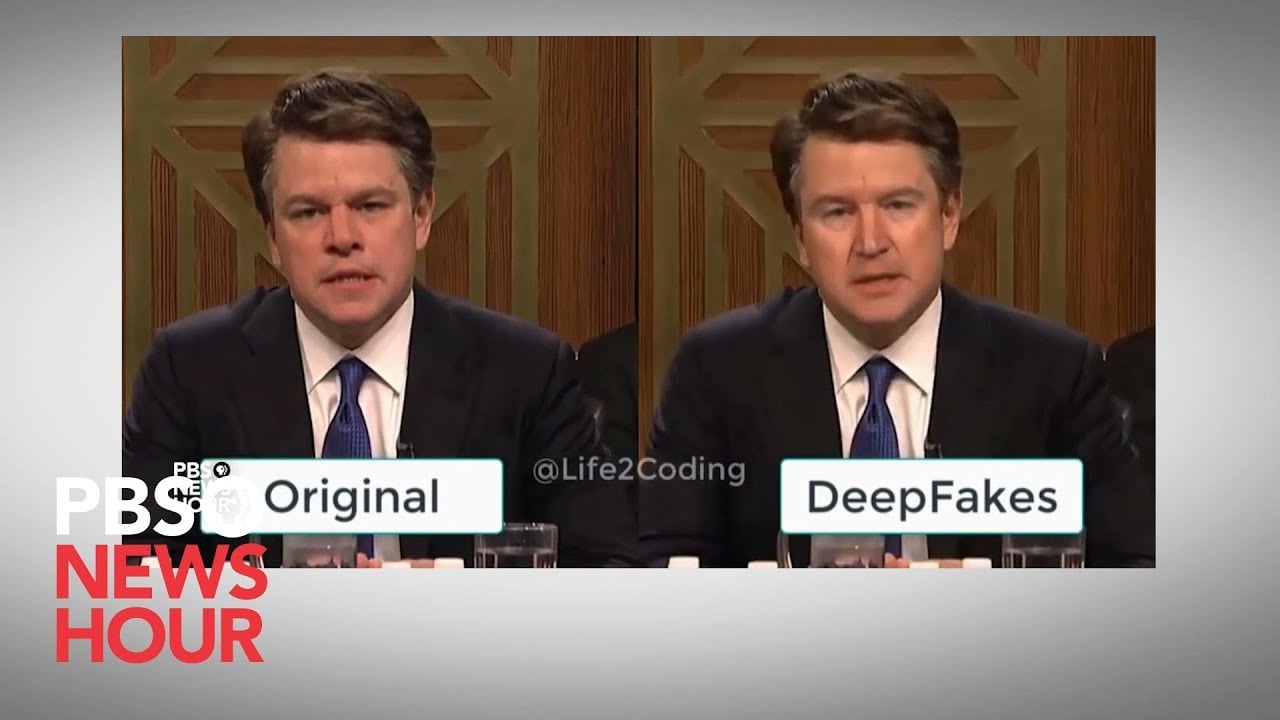

ويعد برنامج الـ الـ DeepFake، يحتوي على نوعاً ما من التقنيات التكنولوجيا التي تقومُ على صنعِ فيديوهات مزيّفة عبر برامج الحاسوب من خِلال تعلّم الذكاء الاصطناعي. تقومُ هذهِ التقنيّة على محاولة دمجِ عددٍ من الصور ومقاطع الفيديو لشخصيّةٍ ما من أجلِ إنتاج مقطع فيديو جديد – باستخدام تقنية التعلم الآلي – قد يبدو للوهلة الأولى أنه حقيقي لكنّه في واقع الأمر مُزيّف.

برنامج الـ DeepFake.. برنامج إباحي أم برنامج خلق أخبار كاذبة

برنامج الـ DeepFake يستخدم في إنشاء مقاطع فيديو إباحية مزيفة لعدد من المشاهير والأشخاص العاديين أيضاً، بالإضافة إلى أنه استخدم برنامج الـ DeepFake لخلق الأخبار والأحاديث الكاذبة والانتقام الإباحي، ظهرت المواد الإباحية المُنتَجة عبر تقنيّة التزييف العميق على الإنترنت في عام 2017 ولا سيما على موقع ريديت، لكنّ هذا الأخير قام بحظرها ونفس الأمر فعلهُ موقعي تويتر وبورن هاب.

وفي عام 2017، نشر مستخدم مجهول لهذا البرنامج الإباحي، على موقع ما يحتوي على العديد من مقاطع الفيديو الإباحية المنتجة بتلك التقنية وتعد الممثلة ديزي ريدلي أول من قامت بلفت الانتباه إلى حساب ذاك المستخدم وما يقوم به فتبين فيما بعد أنه ذو خبرة في مجال صناعة مثل هذه الفيديوهات حيث كان قد نشرَ مقطعًا إباحيًا مزيفًا تظهرُ فيه عارضة الأزياء الإسرائيلية غال غادوت وهي تمارس العلاقة الغير شرعية، مع شقيق زوجها كما نشرَ فيديوهات إباحية أخرى مزيّفة لكل من إيما واتسون، كيتي بيري، تايلور سويفت وَسكارليت جوهانسون. كلّ المشاهد لم تكن حقيقية بالطبع؛ حيثُ تمّ إنشاؤها عبر الذكاء الاصطناعي وقد تمّ اكتشافها بعد وقتٍ قصيرٍ من قِبل خُبراء في مجال علوم الكمبيوتر.

ومع مرور الوقت، قام أحد المبرمجين بإصلاح العديد من الأخطاء في مقاطع الفيديو المزيف، التي يقوم بها هذا برنامج الـ DeepFake، اللعين، الأمر الذي جعلَ من الصعبِ اكتشافها أو التمييز بينها وبينَ المحتوى الحقيقي. في المُقابل حاول آخرون تطوير برامج تقومُ بجمعِ الفيديوهات والصور الحقيقيّة على النت وتخزنها كبيانات من أجل التدريب على التمييز بين المحتوى الوهمي والمحتوى الحقيقي. جديرٌ بالذكر هنا أنّ القسم الفني والعلمي في مجال فيس هو أول من أبلغَ عن هذه الظاهرة لأوّل مرة في ديسمبر 2017 فقامت باقي وسائل الإعلام الأخرى بتغطية الموضوع.